Los modelos no son lo suficientemente buenos para trabajar por sí solos, especialmente con todos los matices de proyectos más grandes. Incluso aunque evites los límites de uso en Antigravity, aún debes darle todo tu proyecto para que funcione. Básicamente, parece que la única forma de conseguir un agente de IA confiable para la programación es a través de una extensión paga. Sin embargo, en lugar de pagarle a otra persona, deberías ejecutar tu propia IA.

Los modelos pequeños son una mejor idea para los usuarios de portátiles

Si tienes el equipo, hazlo.

La mayoría de los desarrolladores piensan que para ejecutar IA se necesita una gran granja de servidores o una tarjeta gráfica cara. Cuando hablo con la gente sobre la ejecución de modelos locales, normalmente escucho quejas de no tener una supercomputadora para manejar la pesada carga de procesamiento. Si intentas cargar un modelo gigante de setenta mil millones de parámetros en una computadora portátil de gama baja de cinco años de antigüedad, tu máquina no funcionará y te dará palabras a un ritmo muy lento. Los procesadores estándar tienen un ancho de banda de memoria mucho menor que las tarjetas gráficas dedicadas. Esto genera grandes problemas al mover datos.

Dado que el procesador tiene dificultades para leer los archivos grandes lo suficientemente rápido, generar una sola línea de código puede llevar unos minutos. Tienes que ejecutar el modelo según con qué estás trabajando. Hay un punto óptimo en el que un modelo local es realmente útil en lugar de ser un frustrante acaparador de recuerdos. Por ejemplo, Qwen 2.5 Coder tiene modelos con 1.500 o 3.000 millones de parámetros. Parecen muchos, pero en realidad son versiones compactas que necesitan sorprendentemente poca memoria del sistema.

Un modelo de 1.500 millones de parámetros comprimido con técnicas de cuantificación ocupa sólo unos dos gigabytes de memoria, lo que le permite ejecutarlo sin problemas junto con su editor de código. Obtendrá los beneficios de un programador de pares inteligente sin necesidad de un costoso procesador de gráficos dedicado. Cuando utiliza un modelo de este tamaño, puede caber fácilmente todo en la memoria de su sistema.

Lo mejor de todo es que solo está en tu CPU. Ese fue mi mayor obstáculo. Tengo VRAM y una tarjeta gráfica, pero no son competitivas ni mucho menos. Al agregar un modelo pequeño de peso abierto a su entorno local, puede tener un asistente que no necesita una conexión a Internet ni un gran presupuesto de hardware.

Configurando tu IA local con GPT4All

Esto te da más libertad que LM Studio

Si bien comencé con LM Studio, recomendaría GPT4All como su chatbot localizado, porque noté que en realidad es más fluido. Simplemente vaya al sitio web de GPT4All, descargue el instalador para su sistema operativo y ejecútelo. No solicita ningún comando de terminal complejo ni dependencias de Python durante la instalación. Querrá asegurarse de que su computadora tenga una buena cantidad de memoria del sistema.

Puedes hacer esto con un servidor de repuesto o por otros medios si los tienes. Es posible ejecutar los modelos más pequeños con 8 gigabytes, pero no intentes utilizar nada más al mismo tiempo. Una vez instalado, puede ir a la barra de búsqueda justo en la pantalla principal para buscar cualquier modelo disponible en la pestaña Explorador de modelos comunitarios.

Para una configuración solo de CPU, es fundamental encontrar el tamaño y formato de modelo correctos. No puedes cargar un modelo enorme y esperar que funcione bien sin una tarjeta gráfica. Una buena opción para codificar en hardware estándar es una versión más pequeña de la familia Qwen2.5-Coder, como los modelos de instrucción 1.5B o 7B.

Cuando busque Qwen2.5-Coder dentro de GPT4All, verá una lista de diferentes cuantificaciones. La cuantización comprime los pesos del modelo para que encajen más fácilmente en la memoria del sistema. La cuantificación q4_0 suele ser el mejor equilibrio entre velocidad y capacidad de codificación, lo que significa que el modelo cae a una fracción de su tamaño original manteniendo la calidad. Simplemente hará clic en el botón de descarga al lado del archivo, esperará a que finalice la descarga y el modelo estará listo para cargarse.

Sin embargo, antes de chatear, debes ajustar algunos parámetros básicos para que el modelo funcione bien en tu procesador. Haga clic en el ícono Modelos para abrir la vista de modelos locales y seleccione su modelo Qwen descargado. En el lado derecho de la interfaz, verá la configuración de hardware. Como no estás usando una tarjeta gráfica, ve al menú Dispositivo y selecciona CPU.

Esto le indica a la aplicación que ejecute todas las capas de cálculo estrictamente en su procesador central. A continuación, deberá ajustar la ventana de contexto, que es la memoria a corto plazo del modelo que contiene su código y su historial de conversaciones. Una longitud de contexto de alrededor de 4096 tokens funciona bien para el procesamiento de la CPU. Si configura el contexto demasiado alto, la aplicación consume toda la memoria del sistema y se vuelve terriblemente lenta.

Mantenga todo local

Me gusta tener mi propia tecnología.

Dado que los pesos del modelo se almacenan en su disco local, no necesita una conexión a Internet para ejecutarse. Obtiene sugerencias de código en tiempo real y funciones de chat directamente en su entorno de desarrollo sin pagar tarifas mensuales ni enviar su código privado a un servidor en la nube externo.

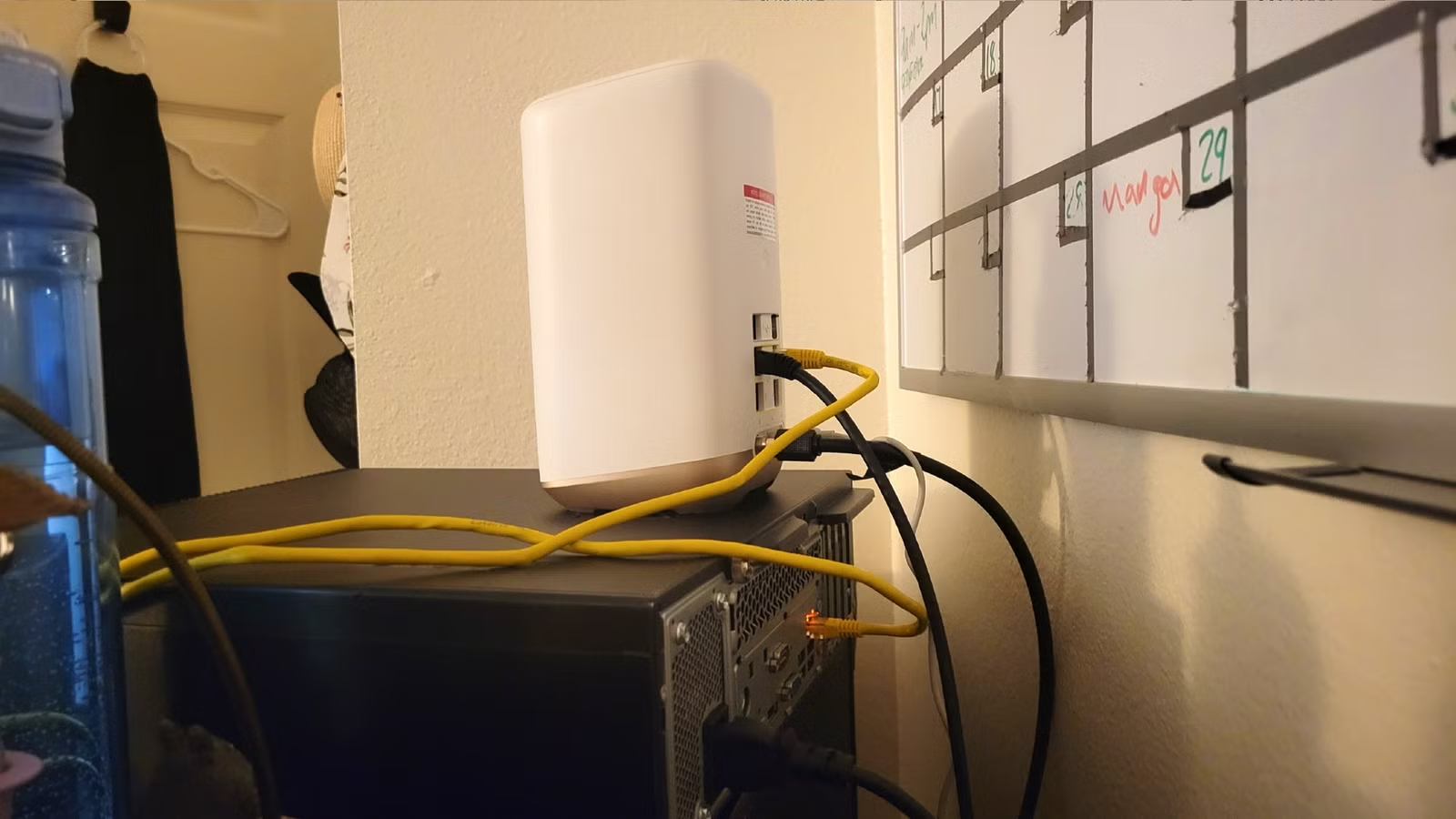

También me aseguro de utilizar una torre más antigua separada como servidor. Además, uso mi enrutador como forma de transferir los datos. Esto era algo que tenía por ahí y tengo demasiados cables Ethernet para contarlos. Si bien no todo el mundo puede utilizar esta tecnología hoy en día, la mayoría de las computadoras están diseñadas para que muchas personas puedan hacerlo. No hizo falta una supercomputadora para programar lo que necesitaba.

La depuración fue lo que me convenció de esta idea, porque odio escanear texto para encontrar un pequeño error. Usaría IA normales, pero no me gusta que todas las IA conozcan mis proyectos y lo que estoy haciendo. Cuando un script falla o genera un error inesperado, puede pegar el seguimiento de la pila directamente en la ventana de chat local y permanece en su computadora.

El asistente puede encontrar problemas de sintaxis y señalar fallas lógicas en un archivo específico. Explica la causa raíz del error y sugiere correcciones de código que puede agregar con un solo clic. Sólo recuerda que si quieres más potencia, depende de ti agregar lo que necesites.

No necesitamos gastar más dinero

Con el creciente costo de los chips, las computadoras nuevas se han vuelto mucho más caras. Afortunadamente, no necesita un modelo nuevo ni actualizar su configuración. Sólo necesitas tu CPU y tal vez algún equipo adicional si quieres ir aún más en serio. No pague ni un dólar más a un operador de nube hasta que lo haya probado usted mismo.

- Marca

-

UGREEN

- UPC

-

Intel serie N de 12.ª generación

- Memoria

-

8 GB (actualizable a 16 GB)

- Bahías de unidad

-

2 x 22TB