Antes de iOS 19, que se espera que se presente en la WWDC 2025 en junio, Apple ha compartido un completo avance de las nuevas funciones de accesibilidad que se integrarán en el sistema operativo. Entre las novedades anunciadas, destacan especialmente dos funciones importantes para CarPlay: soporte de texto grande y reconocimiento de voz avanzado. Estos avances tienen como objetivo ofrecer una experiencia de usuario más accesible y segura tanto para conductores como para pasajeros.

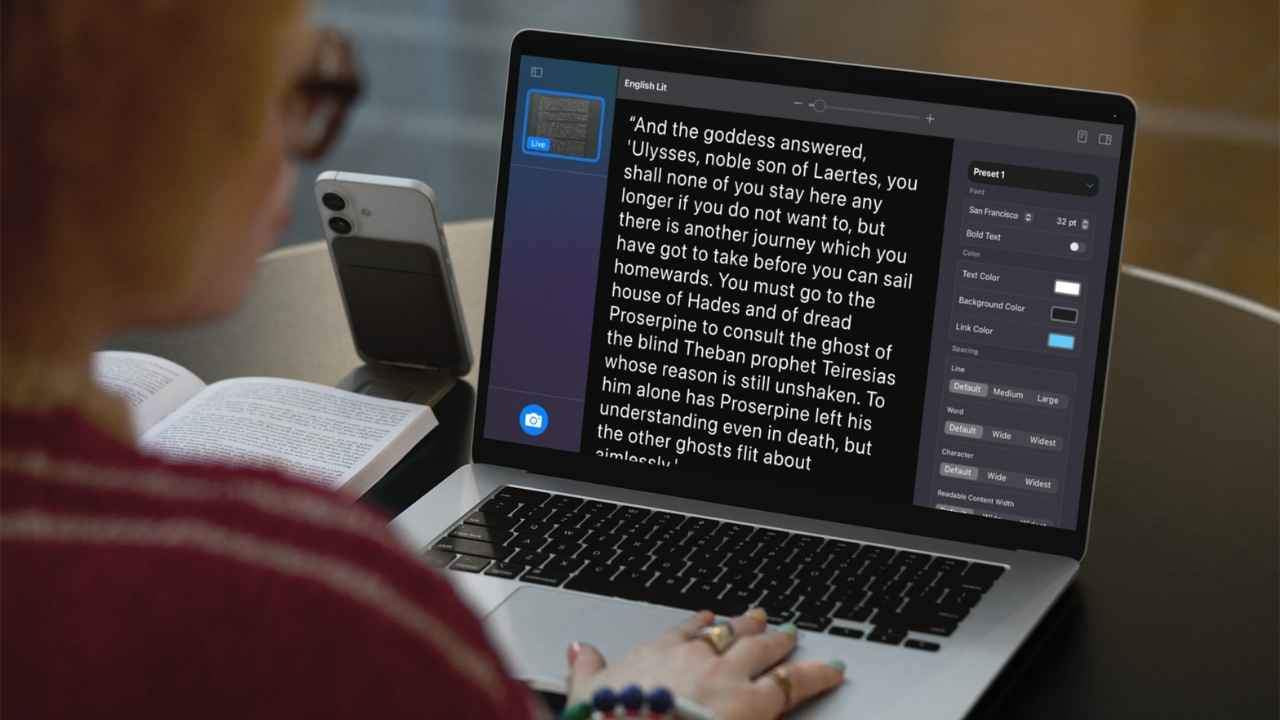

El soporte de texto grande que se integrará en la interfaz de CarPlay hace que esta función, accesible para los usuarios de iPhone desde hace tiempo, esté ahora disponible en las pantallas de los vehículos. De este modo, aumenta la legibilidad de los textos para las personas con dificultades visuales. Además, la nueva función de reconocimiento de voz desarrollada para usuarios con discapacidad auditiva o pérdida de audición pretende aumentar la seguridad en el coche. CarPlay será capaz de reconocer el llanto de un bebé en el vehículo y transmitir esta situación al usuario con una notificación visual. El usuario también recibirá una notificación cuando se detecten sonidos de advertencia fuera del vehículo, como sirenas de policía o bocinas de ambulancias o camiones de bomberos.

iOS 19 amplía la experiencia de accesibilidad personalizable en todos los dispositivos

Las actualizaciones de accesibilidad de Apple no se limitan a CarPlay. iOS 19, iPadOS 19, macOS 16, watchOS 12 y visionOS 3 También están previstas varias innovaciones que podrán utilizarse en plataformas. Una de las más destacadas es que la función de sonidos de fondo será ahora personalizable. Los usuarios podrán cambiar la configuración del ecualizador de estos sonidos, hacer que se apaguen automáticamente tras un determinado periodo de tiempo y definir acciones de automatización a través de la aplicación Shortcuts. Esta función puede ser útil para las personas que quieren reducir las distracciones o que sufren tinnitus.

La función Voz Personal también se ha rediseñado con el apoyo de la inteligencia artificial. Ahora, los usuarios pueden crear una voz digital cercana a su propia voz en cuestión de minutos leyendo sólo 10 frases cortas. Este nuevo sistema ofrece resultados más naturales gracias a la inteligencia artificial que se ejecuta en el dispositivo. Además, la función incluye ahora soporte para el español de México.

Por otro lado, la tecnología de seguimiento ocular llegará al iPhone y al iPad. Los usuarios podrán seleccionar un punto concreto de la pantalla con la mirada fija, lo que hará la navegación más accesible para personas con habilidades motoras limitadas. También se ha acelerado el funcionamiento del teclado; se puede ajustar el tiempo de permanencia, se han reducido los pasos y se ha agilizado la función QuickPath.

Otra innovación destacable ha sido la ampliación del sistema que permite controlar el dispositivo con movimientos de la cabeza. Ahora el iPhone y el iPad podrán reaccionar a las órdenes de la aplicación reconociendo los movimientos de la cabeza. Además, el nuevo protocolo Switch Control desarrollado para personas con graves limitaciones de movilidad permitirá la interacción del dispositivo con interfaces cerebro-ordenador (BCI).

Una aplicación simplificada para el Apple TV que mejora la accesibilidad y un nuevo soporte API para desarrolladores también estarán disponibles en Assistive Access. De este modo, se podrán desarrollar aplicaciones especiales para personas con discapacidad intelectual o del desarrollo.

Además, la función Vibraciones de música es ahora más personalizable. Los usuarios pueden elegir recibir vibraciones sólo para las voces, o soportar vibraciones durante toda una canción. La intensidad de las vibraciones puede ajustarse manualmente.

Con la nueva versión, el sistema de reconocimiento de voz también puede reconocer nombres personales. Cuando se pronuncia el nombre del usuario en voz alta, el sistema lo reconoce y emite un aviso. Esto puede ofrecer una solución práctica, sobre todo en entornos abarrotados o para personas con dificultades auditivas.

Voice Control se está actualizando con el modo de programación en Xcode. También es compatible con la sincronización de vocabulario. También se ha ampliado el soporte de idiomas: Ahora son compatibles el turco, el coreano, el árabe (Arabia Saudí), el italiano, el español (Latinoamérica), el chino mandarín (Taiwán), el inglés (Singapur) y el ruso.

La función de subtítulos en directo también amplía la gama de idiomas. El inglés es compatible en la India, Australia, el Reino Unido y Singapur, mientras que el chino mandarín (China continental), el cantonés (China y Hong Kong), el español (América Latina y España), el francés (Francia y Canadá), el japonés, el alemán (Alemania) y el coreano se han añadido al soporte de subtítulos en directo.

Además, con la función Compartir ajustes de accesibilidad, los usuarios podrán compartir rápidamente sus preferencias de accesibilidad con otro iPhone o iPad. Esto puede ahorrar tiempo, especialmente en zonas públicas o cuando se utilizan dispositivos temporales.

iOS 19 se dará a conocer oficialmente en la keynote de presentación de la WWDC el lunes 9 de junio de 2025, a partir de las 20:00 hora turca. Se espera que la actualización de software se lance en otoño, muy probablemente en septiembre. Muchas de las nuevas funciones de accesibilidad no se limitarán al iPhone, sino que también se integrarán en otros miembros del ecosistema Apple, como el iPad, el Mac, el Apple Watch y el Vision Pro.