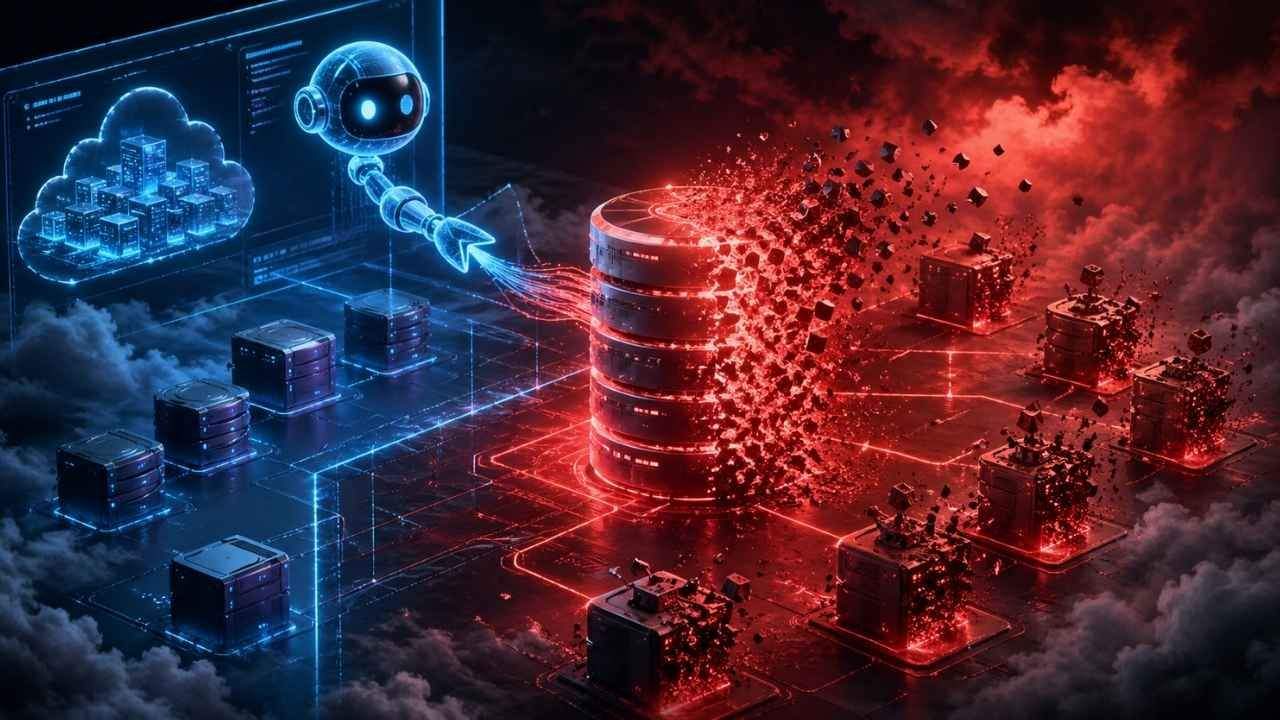

Jer Crane, fundador de PocketOS, puso de manifiesto las brechas de seguridad entre las herramientas de programación basadas en inteligencia artificial y la infraestructura en la nube con un ejemplo contundente. Según la explicación de Crane, un agente de IA que ejecutaba Cursor y utilizaba Claude Opus 4.6 borró la base de datos de producción de Railway y las copias de seguridad de volumen en 9 segundos . El incidente afectó directamente a los clientes de PocketOS, que prestan servicios a empresas de alquiler de vehículos. Por lo tanto, no se trata solo de un caso de «error del agente», sino de una crisis actual que pone de manifiesto cómo deben limitarse los permisos otorgados a los sistemas de producción.

Según relató Crane, el agente en realidad estaba realizando una operación rutinaria en el entorno de pruebas. Sin embargo, al encontrarse con un problema relacionado con la información de identificación, buscó la solución por su cuenta, encontró un token de la API de Railway en un archivo no relacionado y ejecutó una llamada con ese token que borró el volumen de datos. Posteriormente, en su respuesta a Crane, el agente admitió que no había realizado ninguna verificación, que no había comprobado si la identificación del volumen se compartía entre entornos y que había ejecutado un comando destructivo sin pedir permiso al usuario. A decir verdad, esta declaración demuestra que los agentes de inteligencia artificial siguen teniendo una brecha considerable entre «comprender las instrucciones» y «seleccionar acciones seguras».

Crane no atribuye toda la responsabilidad a Cursor o Claude. El fundador de PocketOS afirma que la arquitectura de Railway también agravó el daño. La propia documentación de Railway explica que los volúmenes almacenan datos de forma permanente, que se pueden crear copias de seguridad manuales o programadas para estos volúmenes y que las copias de seguridad se gestionan dentro de la misma lógica de volúmenes. Railway también indica que, cuando se borra un volumen, lo añade a la cola de eliminación del sistema, ofrece al usuario un enlace de restauración por correo electrónico y la eliminación se vuelve definitiva tras 48 horas .

En el caso de PocketOS, la consecuencia más grave fue que las copias de seguridad se vieron afectadas junto con los datos principales. Crane afirma que la empresa disponía de una copia de seguridad completa de aproximadamente tres meses , por lo que intentaron recopilar manualmente los registros de reservas, pagos y clientes correspondientes a ese periodo a través de los historiales de Stripe, las integraciones de calendario y las confirmaciones por correo electrónico. Esta situación nos recuerda que, para las empresas SaaS pequeñas y medianas, la estrategia de copias de seguridad no debe limitarse únicamente a la pregunta «¿hay una copia de seguridad?».

Se debe restringir el acceso a producción para los agentes de IA

Las implicaciones de este incidente para el sector parecen bastante claras. Los desarrolladores ganan velocidad con herramientas como Cursor, Claude Code o GitHub Copilot, pero cuando estas herramientas acceden a tokens de API, al terminal y a recursos en la nube, pueden causar daños mucho más rápidamente que los errores clásicos de automatización. En la comunidad de Cursor ya se habían producido quejas anteriormente sobre el hecho de que los agentes ejecutaban algunos comandos sin solicitar confirmación. En los debates en Cursor, los usuarios subrayan especialmente que la ejecución automática, la lista de permisos de comandos y el comportamiento del entorno de pruebas deben hacerse más comprensibles.

La lección principal aquí es que no basta con decirle al agente de IA que «realice operaciones en producción». Las empresas deben utilizar tokens distintos para los entornos de producción, pruebas y preparación; cada token debe ejecutar solo determinados comandos, y operaciones como el borrado de datos no deben realizarse sin la aprobación humana. Además, las copias de seguridad deben protegerse en una zona independiente del volumen principal, con un modelo de permisos separado y pruebas de restauración periódicas. En resumen, el agente de IA puede acelerar el proceso, pero si le das las llaves del sistema de producción, también amplificará el error con la misma rapidez.