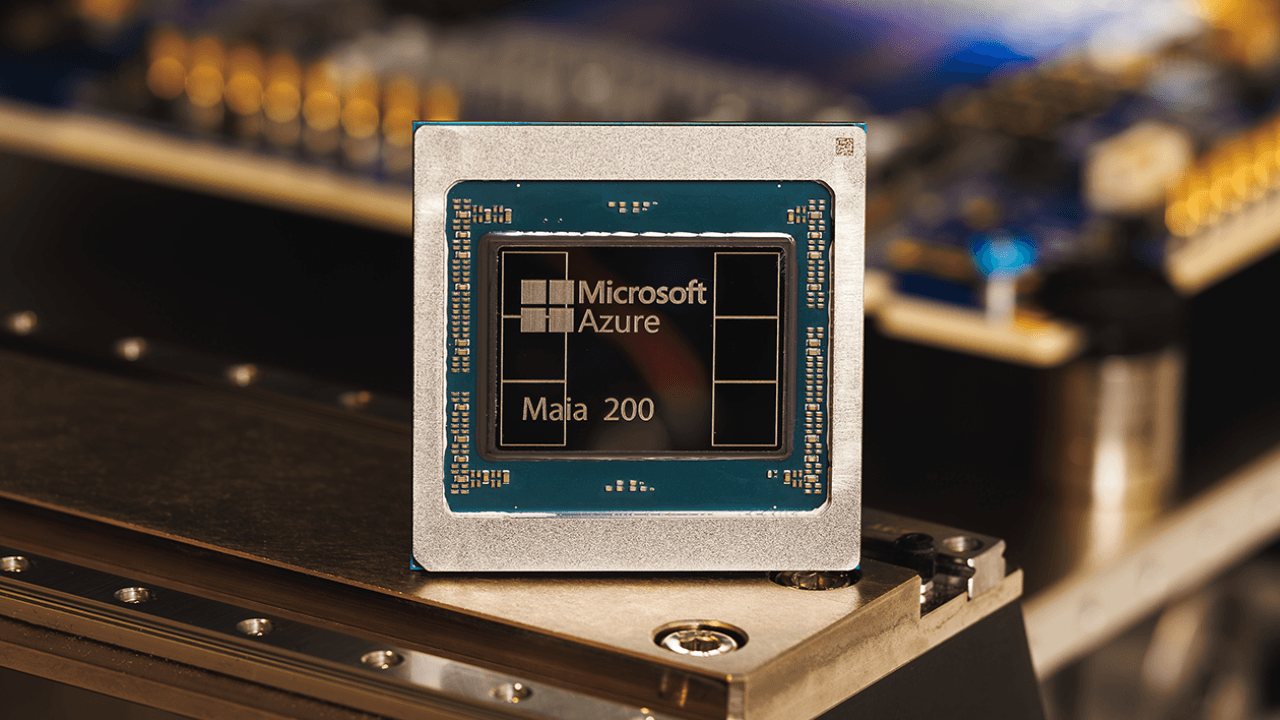

Microsoft, que saltó a la palestra con la producción de sus propios chips de inteligencia artificial denominados Maia 100 y Cobalt 100 en 2023, anunció ayer el lanzamiento de su nuevo chip Maia 200. Maia 200 se describe como un caballo de batalla de silicio diseñado para escalar la inferencia de IA.

Equipado con más de 100 mil millones de transistores, el Maia 200 ofrece más de 10 petaflops con una precisión de 4 bits y casi 5 petaflops con un rendimiento de 8 bits. Se puede hablar de un aumento significativo respecto al modelo anterior. Maia 200 se centra en ejecutar modelos de IA técnicamente potentes de forma más rápida y eficiente. Con Maia 200, Microsoft apunta a que las empresas de inteligencia artificial trabajen con menos interrupciones y menor consumo de energía.

Scott Guthrie, vicepresidente de Microsoft Cloud e Inteligencia Artificial Como afirmó; En la práctica, un nodo Maia 200 puede alimentar sin esfuerzo los modelos más grandes de hoy, ofreciendo mucho espacio para modelos aún más grandes en el futuro. Según la información compartida; Maia ya está trabajando arduamente para respaldar los modelos de IA del equipo de Superinteligencia. El chatbot de Maia también respalda las operaciones de Copilot. Microsoft utilizará Maia 200 para alojar el modelo GPT-5.2 de OpenAI, junto con otros modelos para Microsoft Foundry y Microsoft 365 Copilot.

Con las GPU que ha producido en los últimos años, Nvidia ha ocupado una posición importante para el éxito de las empresas de inteligencia artificial. Los gigantes tecnológicos, por otro lado, recurrieron al diseño de sus propios chips para reducir su dependencia de Nvidia. Mientras que Google tiene sus propias unidades de procesamiento llamadas TPU (unidades de procesamiento tensorial), que se venden como potencia informática accesible a través de la nube, Amazon se destaca con Trainium. En este contexto, Amazon lanzó Trainium3 en diciembre. Las empresas de inteligencia artificial pueden aprovechar las TPU para reducir el costo general del hardware asumiendo parte de la carga computacional que de otro modo se asignaría a las GPU de Nvidia.

Con Maia, Microsoft está en condiciones de competir con estas alternativas. Según lo que compartió Microsoft; Si bien Maia exhibe 3 veces el rendimiento del FP4 de los chips Amazon Trainium de tercera generación, se destaca con un rendimiento superior al rendimiento del FP8 del TPU de séptima generación de Google. Además, Microsoft invita a académicos, desarrolladores, laboratorios de inteligencia artificial y contribuyentes de proyectos de modelos de código abierto a la vista previa del kit de desarrollo de software Maia 200.